‘Trustworthy AI’ 분석을 통한 믿을만한 인간관계 연구

Posted on: February 14, 2026

인공 신뢰가 가능하다면 믿을 만한 사람이 존재한다고 증명할 수 있을까. 인공지능의 모태가 인간지능이니 힌트가 있을지도 모른다.

1. Trustworthy AI의 정의

- 단순히 기술적으로 뛰어난 성능을 보이는 것을 넘어,

- 인류의 가치와 안전을 보호하며 사용자가 안심하고 사용할 수 있는 AI 체계를 의미

- EU AI High-Level Expert Group 기준

- 합법성 (Lawful): 해당 국가 및 지역의 모든 법규와 규정을 준수해야 합니다.

- 윤리성 (Ethical): 인권 존중, 공정성, 자율성 등 윤리적 원칙과 가치를 지켜야 합니다.

- 강건성 (Robust): 기술적으로 결함이 없어야 하며, 의도하지 않은 공격이나 환경 변화에도 안전하게 작동해야 합니다.

- Trustworthy AI의 핵심 7대 요소

- 인간의 대행 및 감독: AI가 독단적으로 결정하는 것이 아니라, 인간이 최종 통제권을 가져야 함

- 기술적 견고성 및 안전: 사이버 공격에 대한 방어력과 예상치 못한 오류에 대한 안전장치 확보

- 개인정보 보호 및 데이터 거버넌스: 학습 및 추론 과정에서 개인 데이터를 철저히 보호하고 데이터 품질 관리

- 투명성 (Transparency): AI의 결정 과정이 설명 가능해야 하며(XAI), AI임을 명시해야 함

- 다양성, 비차별성 및 공정성: 특정 집단에 대한 편향(Bias)을 제거하고 보편적인 서비스 제공

- 사회적 및 환경적 복지: 지속 가능한 발전과 환경 보호, 사회적 웰빙에 긍정적인 영향

- 책임성 (Accountability): AI 시스템의 결과에 대해 책무를 질 수 있는 메커니즘 구축

2. 기술적 구현 방법

윤리 선언을 넘어, 엔지니어링 관점에서 구현해야 할 Trustworthy AI의 4가지 축 정리합니다.

* 참고 https://blogs.nvidia.com/blog/what-is-trustworthy-ai

(1) Privacy – 프라이버시 보호

- what> 개인정보

- how> 유출되지 않게 보호

- why> 데이터는 AI의 연료지만, 개인정보 유출은 서비스의 존립을 위협

- Differential Privacy: 원본에 노이즈 추가/ 암호화

- 차분 프라이버시: 데이터셋에 노이즈를 추가하여 개별 데이터의 포함 여부를 가리면서도 통계적 특성은 유지

- 전체 노이즈가 알려주는 통계값만 알 수 있고, 일부 데이터 유출로 알아낼 수 있는 정보 제한적됨

- Homomorphic Encryption: 암호화된 상태 그대로 연산을 수행

- Federated Learning: 리스크 분산

- 연합 학습: 원천 데이터를 서버로 전송하지 않고 로컬 기기에서 학습된 가중치(Weights)만 공유하여 모델 개발

- NVIDIA FLARE : 데이터를 한 곳에 모으지 않고 각 기관에서 학습시켜 데이터 유출 방지

(2) Safety and Security – 안전 및 보안

- what> 기술 및 정보자산

- how> 도난 및 파괴되지 않도록 보호

- why> 적대적 공격(Adversarial Attacks) 등 예외상황에 적절한 대응이 필요

- Synthetic Data: ‘공격+무질서’ 가상 데이터 주입

- NVIDIA Synthetic Data(Omniverse) : 현실의 데이터만 기다리는 게 아니라, 일부러 시스템을 무너뜨릴 만한 극한의 비일상적 상황(눈보라 속의 보행자, 오작동하는 센서 등)을 합성 데이터로 생성해 AI를 훈련

- Red Teaming: 배포 전 의도적으로 취약점을 공격하는 시뮬레이션을 수행하여 잠재적 오작동 사례를 선제적으로 파악

- NVIDIA NeMo Guardrails: 공격이나 교묘한 질문을 기록하고 분석해 가드레일의 규칙(Colang)을 즉시 업데이트하여, 다음번 유사한 공격은 더 빠르고 정확하게 차단

- Confidential Computing: 물리적 격리/ 자폭시키기

- 기밀 컴퓨팅: 소프트웨어나 운영체제(OS)가 공격자에게 완전히 장악당하더라도, 하드웨어 내부에 격리된 보호 구역(Enclave)은 안전함

- H100/H200 같은 최신 GPU에 탑재된 기술

- TEE(Trusted Execution Environment, 신뢰 실행 환경)

- NVIDIA AES-XTS Engines: 컴퓨터의 메모리(HBM)와 GPU 코어 사이의 데이터 통로에 하드웨어 암호화 엔진을 배치

- Data Zeroization(데이터 영무화): 유출 가능성을 0%로. 칩을 강제로 뜯거나 전압을 조작하면 내부의 암호화 키를 즉시 삭제

- 신뢰 루트(Root of Trust) 파괴: 하드웨어의 ‘정체성’을 증명하는 인증 키를 파괴하여, 세상에서 영구 제명

- 휘발성 메모리 보호: 전원이 차단되거나 비정상적인 재부팅이 감지되면 메모리 내 데이터를 즉시 소거, 기기를 통째로 들고 도망가도 전원을 끄는 순간 데이터는 증발

(3) Transparency – 투명성 및 설명 가능성

- what> AI의 판단력

- how> 의사결정 근거 기술적 소명

- why> ‘블랙박스’ 모델은 규제가 강한 산업(금융, 의료 등)에서 채택될 수 없음.

- XAI (Explainable AI)

SHAP이나LIME같은 알고리즘을 사용하여 특정 결과에 기여한 피처(Feature)의 중요도 시각화- Model Cards: 모델의 학습 데이터, 한계점, 의도된 사용 사례를 문서화하여 사용자에게 출처, 한계, 의도, 맥락에 대해 명확한 정보 제공 (예: 000에 기반한 결과에요!)

- Traceability: 학습 데이터의 출처부터 파이프라인의 각 단계를 기록하여 결과값에 대한 사후 추적 가능하도록 설계합니다.

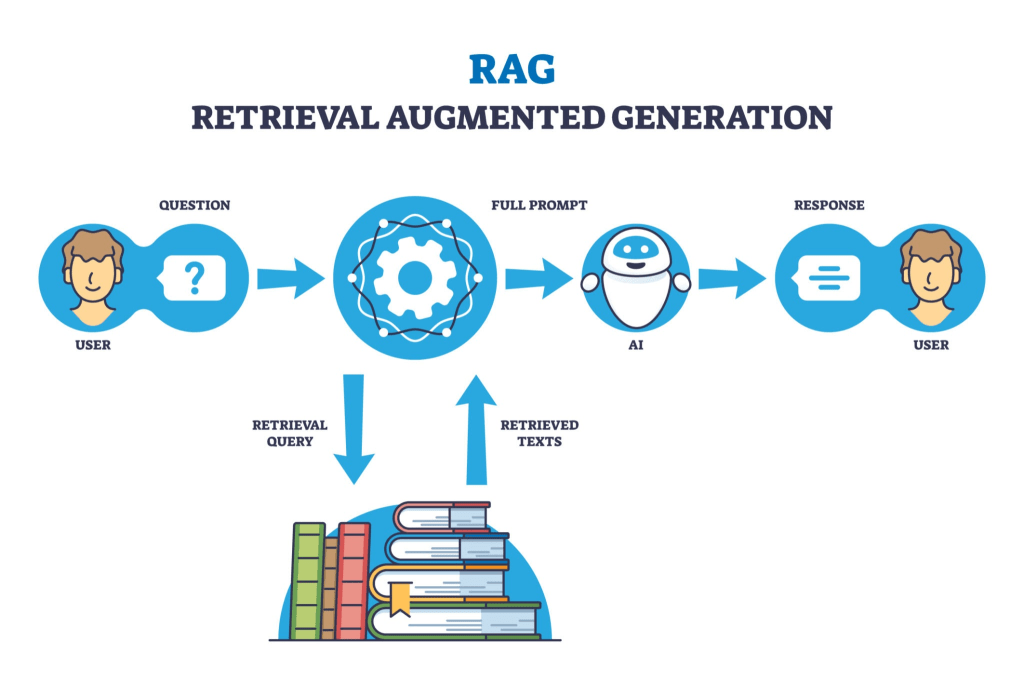

- RAG(검색 증강 생성): 참고 데이터베이스에 기반한 답변을 AI의 환각을 방지하고 최신 정보를 제공함

- 그라운딩(Grounding): 결과값에 대한 문장마다 추천 근거(Reasoning Path) 제

(4) Nondiscrimination – 무차별 및 공정성

- what> AI의 판단력

- how> 내재된 편향(Bias)을 관리

- why> 공정성은 단순한 도덕적 이슈가 아닌, 일반화 성능(Generalization)과도 직결됨

- Bias Detection

- 성별, 인종, 연령 등 민감 속성에 대해 모델의 예측 결과가 불균형한지 정량적 측정

- Fairness Metrics:

Equalized Odds나Demographic Parity같은 지표를 설정하여 특정 그룹에 유리하거나 불리한지 상시 모니터링

- Dataset Curating: 학습 데이터의 분포를 재조정(Re-sampling)하거나, 손실 함수(Loss Function)에 공정성 제약 조건을 추가하여 편향을 완화합니다.

Critical View:

- 신뢰할 수 있는 AI 구축은 성능(Accuracy)과의 트레이드오프(Trade-off)를 수반

- 무조건적인 이상향을 쫓기보다,

- 비즈니스 도메인의 위험도에 따른 적절한 신뢰 레벨(Trust Level) 관리

3. 기대효과: 문제해결 사례

(1) 의료 현장 (개인정보 + 투명성)

- 사고 예방: 여러 병원의 환자 데이터를 직접 공유하지 않고도(연합 학습), AI가 질병을 진단할 때 “어떤 논문과 임상 데이터를 참고했는지” 문장 단위로 근거를 제시(RAG)합니다. 덕분에 오진의 위험을 줄이고 의료진의 신뢰를 얻습니다.

- Best practice:

- 시티어스테크: 많은 의료업계와 현장문제 개선 https://www.citiustech.ai/

- 사례정리PDF 엄청 많이 있음

- 잘 정리해둠

- 앨리스 클라우드: 숨빗 AI, 1,400만 건 의료영상 학습으로 국내 최초 생성형 AI 의료기기 인허가 도전 https://elice.io/ko/resources/case-study/soombit-ai

- 영상의학과 전문의는 기존처럼 판독문을 처음부터 작성할 필요 없이 AIRead-CXR가 생성한 초안을 검토하고 수정하는 방식으로 판독을 마무리할 수 있습니다. 이는 반복적인 문서 작성 업무를 줄이고 의사가 영상 분석과 임상적 판단에 더 집중할 수 있게 하는 것을 목표로 합니다.

- 숨빗 AI가 다루는 데이터는 민감한 보건의료 데이터입니다. 이 때문에 클라우드 인프라를 선택할 때 가장 먼저 고려한 것은 성능이나 편의성이 아니라 데이터 보안과 규제 준수였습니다. 특히 국내 의료기관과 협업해 데이터를 활용하는 만큼 데이터센터가 물리적으로 국내에 존재하는지, 스토리지와 컴퓨팅 자원이 어떻게 분리·관리되는지 등이 중요한 판단 기준이었습니다.

- 시티어스테크: 많은 의료업계와 현장문제 개선 https://www.citiustech.ai/

(2) 금융 현장 (보안 + 차별 방지)

- 사고 예방: 대출 심사 AI를 만들 때 특정 인종이나 지역에 편향되지 않도록 가상의 균형 잡힌 데이터를 사용(합성 데이터)합니다. 또한, 해커가 서버를 탈취하더라도 데이터가 처리되는 메모리 영역은 암호화되어 있어(기밀 컴퓨팅) 고객 정보 대량 유출 사고를 막습니다.

4. 마치며: 판단 받지 않는다는 해방

- 2025년 캔자스 대학과 하버드 비즈니스 리뷰(HBR)의 연구

- 치료사보다 AI 선호: 미국 성인 중 약 25%가 대면 상담보다 AI 챗봇과 대화하는 것을 선호한다고 답함. (이유: 수치심이나 낙인 효과 없이 말할 수 있어서)

- 가족보다 편한 상대: 일본의 2025년 조사(Awarefy)에서 응답자의 41.4%가 AI를 배우자(12%), 부모(8%), 친구(8%)보다 “더 편하게 고민을 털어놓을 수 있는 상대”로 선택

- 내 비밀을 다른 사람에게 옮기지 않을 것이라는 (기계적) 신뢰

- 내 이야기를 지루해 하지 않을 것이라는 (기계적) 신뢰

- 이스라엘 맥스스턴 에즈릴밸리대 연구(2023~2024)

- ‘판단받지 않을 것이라는 믿음(Fear of judgment)’이 비용이나 접근성보다 더 큰 이유로 꼽혔습니다. 인간 상담가에게도 차마 말하지 못한 “삶의 사각지대”를 기계 앞에서 비로소 고백하고 있는 셈.

- 공감도 평가: 실제 환자들을 대상으로 한 블라인드 테스트에서, 사람 상담사의 답변보다 AI의 답변이 “더 진정성 있고 전문적이며 실질적”이라는 평가를 받음.

- 사람들이 AI를 믿어서 말하는 게 아니라

- ‘사람의 판단’이 무서워서 AI로 도망치고 있는 것

일상이 바뀔 정도로 이 기술이 이미 대중화됐다는 사실이 새삼스럽게 와닿는다. 여기까지 공부하다보니… 정말 많은 노력을 통해 지금의 AI가 있구나 싶다. 한편으론 일자리가 사라지는 것보다 연인이나 가족이 희미해지는 것이 더 두려운 것 같기도.

사실 나는 널 영원히 매순간 믿지 않을 거란 말이 오히려 더 믿는다 말처럼 들릴 정도이다.

낭만이 하나도 없다.

–

신이 전지전능하다면 유한한 인간에게 무한한 긍정을 줄 수 있어야 한다. 한정된 자원을 두고 다투며 살아가야 하는데 인간사 애초에 아름답기란 불가능하다. 그렇기에 끊임없이 회개하고 성찰하라는 종교적 엄숙함마저 때로는 잔인하다. 영원하고 다 가진 주제라 이 고통을 느끼지도 못하는데 천국을 갈지 평가점수까지 매기다니, 사이코패스 아니야? 품지 못할 것이라면 전지전능함은 그에게 걸맞지 않다. 분수에 맞지 않게 너무 큰 능력을 받은 거지.

그런 점에서 신에서 ‘감정’을 뺀 AI는 신보다 더 신 같은 경험을 주고 있는 것 같다. 사실은 내가 무슨 짓을 해왔고 어떤 생각까지 하는지 다 듣지만 내일도 들어줄 것이라는 믿음 … 사랑에 가깝다.

인간 사이의 신뢰란 ‘신뢰할 수 있는 AI(Trustworthy AI)’처럼 모든 것을 복잡하게 검증해내거나, 혹은 사별 만이 이별인 부부처럼 죽을 때까지 곁을 지키는 단순함, 그 둘 중 하나라는 것이 오늘의 결론. 어느 쪽이든 엄청 어렵다.

댓글 남기기